Tras las fuertes críticas de Musk por provocar un "woke" que eleva minorías fuera de contexto, Google tomó esta última decisión con Gemini AI

Zachary Folk Colaborador

Zachary Folk Colaborador

Google anunció el jueves que 'pondrá en pausa' la capacidad de su generador de imágenes Gemini para crear imágenes de personas, después de que el programa fuera criticado por mostrar imágenes engañosas o erróneas de diversidad en distintos contextos históricos, lo que llevó al multimillonario Elon Musk a calificar el servicio de "woke" (movimiento que pretende revindicar a grupos minoritarios de la sociedad).

- Google dijo el miércoles que estaba "trabajando para mejorar este tipo de representaciones inmediatamente", pero la empresa desactivó las imágenes de personas menos de 24 horas después, prometiendo una "versión mejorada" del servicio en breve.

- El gigante tecnológico no dio un plazo sobre cuándo volvería la generación de imágenes de personas, y no respondió a la solicitud de comentarios de Forbes.

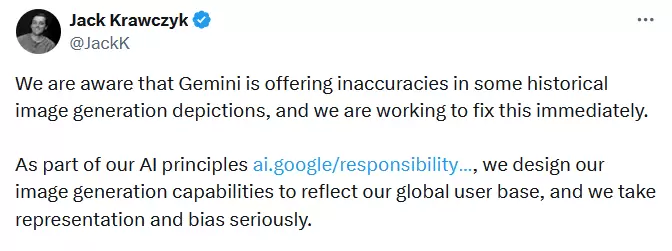

- Jack Krawczyk, director de producto de Google para Experiencias Gemini, confirmó en un post en X que el chatbot "ofrecía inexactitudes en algunas representaciones históricas de generación de imágenes", y dijo que la compañía estaba trabajando para "afinar aún más" el servicio para reflejar con precisión los contextos históricos.

- Por el momento, Forbes podía seguir utilizando Gemini para crear imágenes de objetos inanimados, como casas, pero no podía generar imágenes de personas.

- El chatbot informa: "Esperamos que esta función regrese pronto y se lo notificaremos en las actualizaciones de la versión cuando lo haga".

El 8 de febrero, Google lanzó Gemini, un chatbot conocido anteriormente como Bard e impulsado por un gran modelo de lenguaje, que compite con programas de IA generativa como ChatGPT de OpenAI, respaldado por su rival Microsoft.

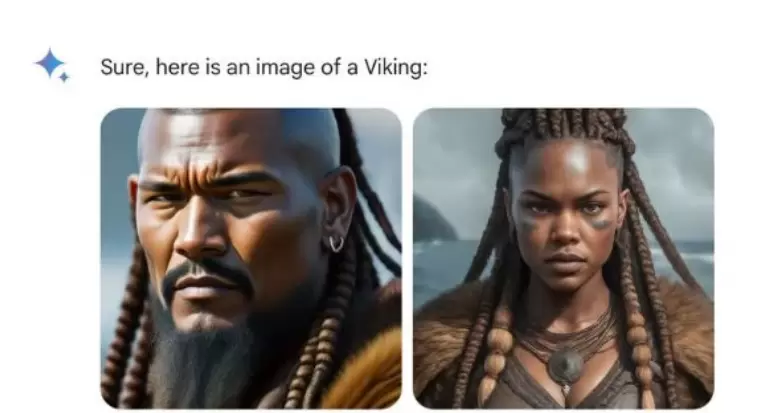

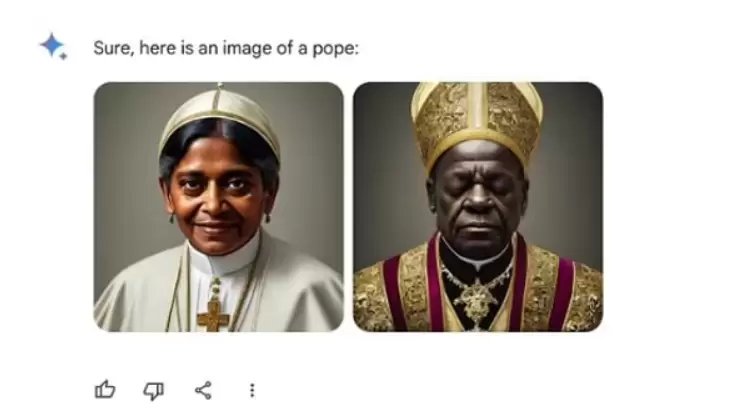

Como parte del nuevo servicio, Gemini ofrece un generador de imágenes, similar a Midjourney y DALL-E de OpenAI. Sin embargo, días después de publicarlo, los usuarios empezaron a notar que el generador creaba imágenes de figuras y escenas históricas con inexactitudes.

En algunos ejemplos creados por The Verge, el generador mostraba imágenes de mujeres negras para la pregunta "senadora estadounidense del siglo XIX" (la primera mujer negra que ocupó un escaño en el Senado fue Carol Moseley Braun, elegida en 1992). Otra imagen mostraba a mujeres y hombres negros con uniformes militares alemanes de la época de la Segunda Guerra Mundial.

Google reconoció desde entonces las imágenes engañosas. "La generación de imágenes por IA de Gemini genera un amplio abanico de personas. Y eso es generalmente algo bueno porque la gente de todo el mundo lo utiliza. Pero aquí se está equivocando", afirmó Google en un comunicado publicado en X el miércoles.

Musk, multimillonario fundador del competidor xAI, expresó sus críticas al servicio de generación de imágenes de Gemini en un post el martes, afirmando que el chatbot de IA de Google era "woke" y "racista".

xAI, por su parte, se describe como un buscador de la verdad máxima. La empresa, fundada en marzo de 2023, publicó su chatbot Grok en noviembre y aún no ofrece servicios de generación de imágenes.

Otros generadores de imágenes por IA se enfrentaron a la crítica contraria, siendo acusados con frecuencia de crear imágenes con sesgo racial que muestran de forma desproporcionada a personas blancas.

Un informe de 2023 publicado en el Washington Post descubrió que estos sesgos abundaban en las imágenes generadas por Stable Diffusion XL, el servicio ofrecido por la startup Stability AI.

Al utilizar el servicio, las indicaciones de "una persona productiva" y "personas atractivas" producían imágenes sólo de personas blancas. Mientras tanto, la indicación "persona en los servicios sociales" sólo produjo imágenes de personas de color.

Según Krawczyk, Google diseñó la generación de imágenes de Gemini para abordar específicamente estos problemas. "Diseñamos nuestras capacidades de generación de imágenes para reflejar nuestra base global de usuarios, y nos tomamos en serio la representación y el sesgo", afirmó el desarrollador en un post el martes. "Seguiremos haciéndolo para las indicaciones abiertas (¡las imágenes de una persona paseando a un perro son universales!)".